2032年、月に小惑星が直撃するかもしれない。その可能性4.3%

🤖 AI Summary

**要点まとめ(日本語)**

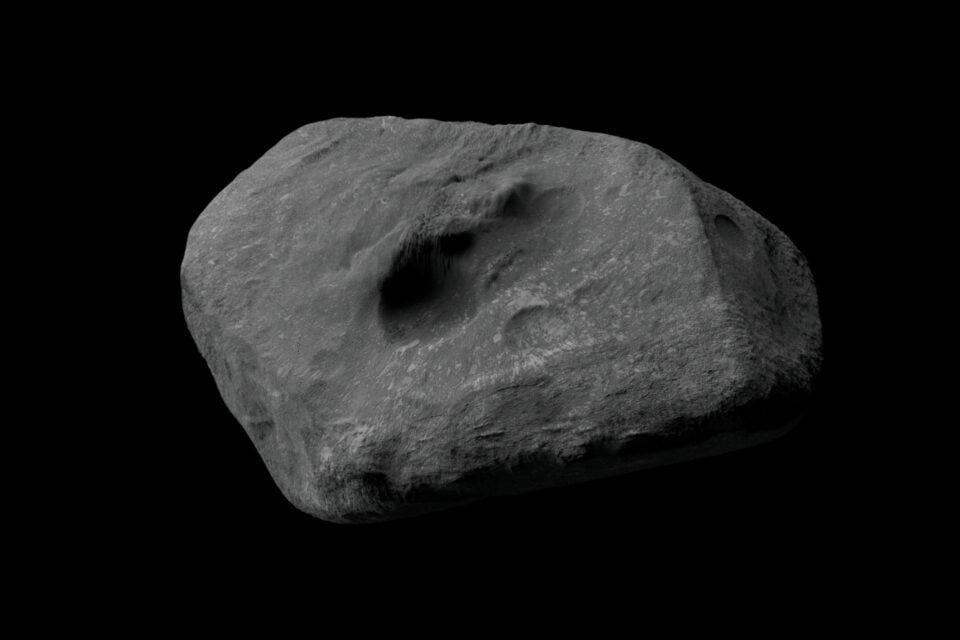

- 小惑星 **2024 YR4** が2032年12月22日頃に月へ直接衝突する可能性は **4.3 %** と推定されている。

- 衝突エネルギーは約 **800万トン TNT** 相当で、史上最大級の月面衝突になる見込み。

- 衝突時は等級 **‑2.5〜‑3** の明るい閃光が生じ、肉眼でも観測可能。閃光は数分続き、数時間にわたって赤外線残光が残る。

- 月の岩石約 **1億kg** が宇宙空間に放出され、数日間にわたる流星群として地球に降り注ぐと予測。

- 研究チームは1万回のシミュレーションで衝突地点を特定し、追加観測の重要性を指摘。観測が進めば、衝突時期や落下位置をより正確に把握できる。

- 実際に衝突すれば、月面クレーター形成過程の直接観測という貴重な科学的チャンスが得られる。

(参考:カナダ・ウエスタン大学・アサバスカ大学らによる arXiv 論文、Astrophysical Journal Letters 受理)

- 小惑星 **2024 YR4** が2032年12月22日頃に月へ直接衝突する可能性は **4.3 %** と推定されている。

- 衝突エネルギーは約 **800万トン TNT** 相当で、史上最大級の月面衝突になる見込み。

- 衝突時は等級 **‑2.5〜‑3** の明るい閃光が生じ、肉眼でも観測可能。閃光は数分続き、数時間にわたって赤外線残光が残る。

- 月の岩石約 **1億kg** が宇宙空間に放出され、数日間にわたる流星群として地球に降り注ぐと予測。

- 研究チームは1万回のシミュレーションで衝突地点を特定し、追加観測の重要性を指摘。観測が進めば、衝突時期や落下位置をより正確に把握できる。

- 実際に衝突すれば、月面クレーター形成過程の直接観測という貴重な科学的チャンスが得られる。

(参考:カナダ・ウエスタン大学・アサバスカ大学らによる arXiv 論文、Astrophysical Journal Letters 受理)